一、著名的大佬课题组 ...I am leading a group for explainable AI. The related topics include explainable CNNs, explainable generative networks, unsupervised semanticization of pre-trained neu...

”ai 深度学习 可解释性 AAAI“ 的搜索结果

简单的说,可解释性就是把人工智能从黑盒变成了白盒。随着机器学习和人工智能技术在各个领域中的迅速发展和应用,向用户解释算法输出的结果变得至关重要。人工智能的可解释性是指人能够理解人工智能模型在其决策过程...

AI模型可解释性是当前非常火爆的领域,本资料是AAAI 2020 tutorial的PPT,内容非常丰富,值得学习

Year Publication Paper Citation code 2020 ...Explaining Knowledge Distillation by Quantifying the Knowledge ...High-frequency Component Helps Explain the Generalization of Convolutional Neural Networks ...

一些深度学习可解释性相关论文

AAAI人工智能大会会议录,2019年。 DNN-CS-STM32-MCU [Tensorflow] 实验室信号处理-深度神经网络在STM32 MCU板上用于基于CS的信号重建 提示CSNet [Matconvnet] W. Shi等人,《使用卷积神经网络的图像压缩传感》,...

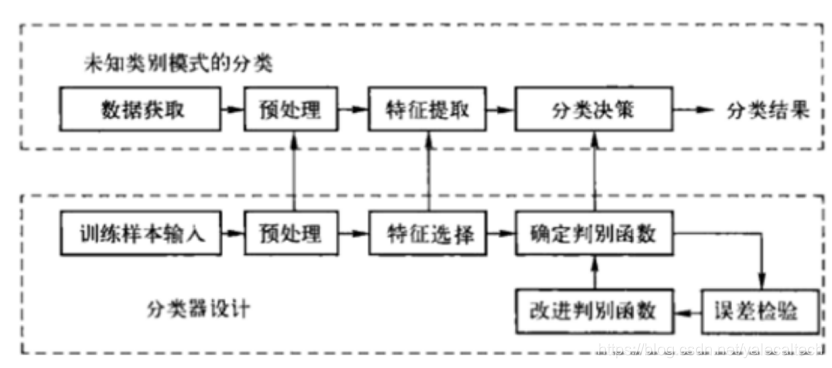

“人工智能”这个概念新鲜时髦但又含混模糊,同时包罗万象。尽管如此,我们仍尝试对 人工智能进行定义:用一台机器处理来自其周围环境的信息,然后将这些信息分解并进行适 当决策,以达到实现某些期望结果的目的。根据...

全文共2703字,预计学习时长7分钟图源:unsplash或许这是你第一次听到人工智能前面加“可解释的”这个形容词,但其实它的涵义你一定能理解。可解释的人工智能(XAI)是指构建AI应用...

用大白话说就是是一个中间件,比如你PyTorch的模型想转换别的,就得通过ONNX,现在有的框架可以直接转,但是在没有专门支持的时候,ONNX就非常重要了,万物先转ONNX,ONNX再转万物。NCNN的速度是超过TFLite的,但是...

活动议程日期:3月17日(周四)时间主题14:30-14:35开场简介许志钦 上海交通大学自然科学研究院/数学科学学院长聘教轨副教授,青源会会员14:35-15:20深度学习可解释理论的...

随着人工智能领域的迅猛发展,大规模深度学习模型已经成为AI研究和应用的热门话题。构建和优化AI大模型的关键技术,涵盖了模型设计、训练优化、硬件加速以及模型部署等方面。在人工智能领域的不断发展中,构建和优化...

我们将可信赖性理解为可解释性和鲁棒性的结合。生成式分类器(GC)是一类很有前途的模型,据说可以自然地实现这些特性。然而,这主要是在过去的MNIST和CIFAR等简单数据集在这项工作中,我们首先开发了一个架构和训练...

论文名称:Self-Supervised Logic Induction for Explainable Fuzzy Temporal Commonsense Reasoning论文作者:蔡碧波,丁效,孙洲浩,秦兵,刘挺,王宝军,尚利峰原创作者:蔡碧波出处:哈工大SCIR进NLP群—>...

吴恩达老师曾经说过,看一篇论文的关键,是复现作者的算法。 然而,很多论文根本就复现不了,这是为什么呢?...深度学习的很多算法,是靠大力出奇迹的方法做出来的。比如谷歌、facebook的一些算法,依靠强大.

推荐文章

- C#反序列化无法找到程序集_未能找到程序集“g:\c#%5cc#%20%e4%b8%8a%e4%bd%8d%e6%9c%ba%5-程序员宅基地

- Jet-Lube EZY-Turn Kopr-Kote Deacon_dpezy-程序员宅基地

- mpi4py 中的单边通信相关操作_win.fence() win.free()-程序员宅基地

- MIT 6.824 Lab1 MapReduce实现思路_mitmapreduce实现csdn-程序员宅基地

- 使用Android studio创建一个简单项目_android studio简单项目-程序员宅基地

- Bootstrap 弹出框-程序员宅基地

- 基于Wemos D1 Mini Pro开发板的天气显示器_arduino wemos d1 mini-程序员宅基地

- Android 双屏异显(兼容android8)_android service 检测是否双屏-程序员宅基地

- 【全开源】JAVA婚恋相亲红娘牵线系统源码支持微信小程序+微信公众号+H5+APP-程序员宅基地

- 6.python输入整数年份,判断对应整数年份是否为闰年并输出结果_判断闰年的python程序直接输入一个代表年份的正整数-程序员宅基地